情報幾何学を嗜む ~ダイバージェンスの不変性~

前回までの記事で確率分布のパラメータが成す空間の双対平坦性や、重要な確率分布族である指数型分布族について説明してきた。本稿では確率分布のパラメータが成す空間の幾何学的な構造について不変性というキーワードからアプローチし、KLダイバージェンスがいかに特別なものであるかについて説明する。

なお、不変性について議論するにあたり、確率分布としては離散・連続のどちらを考えても良いはずである。しかし、残念ながら参考にしている本[1]が離散確率分布のみをターゲットに議論しているため*1、ここでもそうすることにする。

不変性の要請

確率分布族から双対平坦な空間を構成する際、その空間における点を定めるのは確率分布のパラメータ

であり、

ではない。そのため、例えば

が全単射により可逆的に変換される場合などでは、確率分布の表現の仕方は変わってもパラメータは変わらないため、この空間の幾何学的構造にも変化がない事が望まれる。

この考え方をもう一歩進めて、十分統計量というものを考える。十分統計量とは何であるかを説明しだすと長くなるので詳細な解説は他サイト[2]に譲るが、ざっくり言えばパラメータを推定するために十分な統計量である。

を

の十分統計量とすると、Fisherの因子分解定理[3]により確率分布

は以下のように書ける。

この時、以下のように不変性の要請が定められる[1]。

fダイバージェンス

不変性が要請される幾何学的量として、ダイバージェンスは重要なものの1つである。不変なダイバージェンス*2の具体例はいろいろ考えられるが、不変性に加えてさらに分解可能性という性質を要求するとき、それらを満たすダイバージェンスはfダイバージェンスのみである事が知られている。分解可能なダイバージェンス、及びfダイバージェンスの定義を以下に示す[1] (記号の導入のために一部改変して引用する)。

という条件は

となるために必要である。

双対ダイバージェンス

fダイバージェンスには双対ダイバージェンスが存在する。まず、以下のような関数を考える。

これを用いたfダイバージェンスは以下のようになる。

を

と書くことにすると、以下の式が成り立つ。

具体例

標準凸関数

fダイバージェンスには以下の2つの性質がある。

- 凸関数

に

(

は定数) という形の1次式を加えたものを用いても値が変わらない。

- 凸関数

を定数倍した

を用いると値が

倍される。

これより、の代わりに以下の凸関数を考えても良い。

は

を満たす。このような凸関数

を標準凸関数と呼ぶ。

双対平坦空間を導く不変で分解可能なダイバージェンス

ここまでで確率分布の空間や正測度空間に導入される不変なダイバージェンスとしてfダイバージェンスについて説明した。しかし、幾何学的構造が不変性を持っていると望ましいと思う一方で、情報幾何学的な議論を展開する上でやはり双対平坦性は欠かせない。

では、不変性を持ち、かつ双対平坦空間を導くような良いとこ取りなダイバージェンスは存在しないのだろうか?この疑問の答えを与えるのが以下の定理である[1]。

まとめ

本稿では不変で分解可能なダイバージェンスとしてfダイバージェンスを導入し、さらに双対平坦性も兼ね備えるダイバージェンスとしてKLダイバージェンスとダイバージェンスの特徴付けを行った。

正直、本[1]だけでは理解できない部分が多く、書きたかったことの全てを書ききれなかったが、これまでの一連の記事を書き上げる中で情報幾何学に対する一定の理解は得たと思う。

ただし、触れられたのは基礎的な部分だけで、応用面については取り上げることが出来なかった。本[1]をパラパラと読み進めてみると、情報幾何学の手法を用いて解決された実用的な問題もあるようだが、数学的な難易度は更に増しているように見える。今すぐにとはいかないが、そのうち応用についても理解したい。

参考

[1]

![別冊数理科学 情報幾何学の新展開 2014年 08月号 [雑誌] 別冊数理科学 情報幾何学の新展開 2014年 08月号 [雑誌]](https://images-fe.ssl-images-amazon.com/images/I/51aLAohK4BL._SL160_.jpg)

別冊数理科学 情報幾何学の新展開 2014年 08月号 [雑誌]

- 出版社/メーカー: サイエンス社

- 発売日: 2014/08/22

- メディア: 雑誌

- この商品を含むブログを見る

[3] 十分統計量 - Wikipedia

*1:ここまでずっと連続確率分布を扱っておきながら、いざ数学的な扱いが面倒になると離散確率分布に逃げる本書のスタンスは好ましいものとは思えない。

*2:この用語はもっと厳密に定義しておくべきであるが、本[1]やネット上の情報を漁っても納得のいく答えが得られなかった。そのため、大変心苦しいが定義を誤魔化したまま議論を進めている。

*3:の場合だけ特別な式が与えられている。本[1]によるとこれは

の式の極限になっているとのことだが、明らかに

の時に発散する。一体どういうことなのだろう…もし何か理由があってこの定義に妥当性があるのだとしても、全く自明ではないので説明して欲しかった。

*4:本[1]の式は符号が間違っている

*5:「正測度空間」という言葉をググってみても、全然それらしいページがヒットしない。この用語はどれくらいフォーマルなものなのだろうか。

*6:では定義されないが、本[1]でそれに対する言及はない。恐らく、また極限を考えるのだろう。

*7:本[1]からはこのように読み取れたのだが、計算が複雑で、結局自分では確かめることができなかった。どなたか計算を追うことができた方がいれば、ぜひ真偽の程を教えて頂きたい。

情報幾何学を嗜む ~指数型分布族の幾何学~

前回の記事では双対平坦空間について説明した。これまでの記事では具体的な確率分布族は登場せず、ひたすら抽象的な議論が続いたが、いよいよ具体的な確率分布族について考えてみる。本稿では情報幾何学的に重要である指数型分布族に着目し、その幾何学的な構造について述べる。

指数型分布族

定義

指数型分布族とはを確率変数、

をパラメータとして、確率密度関数が以下のように書ける確率分布の族である。

いきなりだが、ここで (情報幾何学的な議論の本筋とはあまり関係ないが) 重要なポイントがある。それは、確率密度関数は積分してなんぼであり、その積分とは通常はLebesgue積分であるため、確率密度関数は測度と密接な関係にあるということである。確率密度関数と測度の両方が定まって初めて積分により確率を求める事ができる。

今、に着目すると、これは

に依存していないため、確率密度関数から測度に追いやる事ができる。そうして、積分する際には測度として

を折り込み済みのものを使用するのである。

このように考えることで、指数型分布族の定義式からを省く事ができる。ここでさらに

と置き、

とすれば、確率密度関数は以下のように表せる。

左辺は確率密度関数なので、定義域全域で積分して1にならなければならない。この条件よりは以下のようになる。

念のため述べておくが、上記の計算に登場する積分では測度にが掛かる影響を考慮済みであると暗に仮定している。以降の計算でも同様である。

の凸性

の凸性

前節で登場したは凸関数である。それを示すためにHesse行列を求めてみよう。

・・・(1)

これより、Hesse行列は共分散行列となる。共分散行列は半正定値であるため、は凸関数である[2][3]。

指数型分布族の双対平坦構造

これまでの議論により指数型分布族には自然と凸関数が備わっていることが分かった。前回、前々回の記事より、凸関数が与えられればBregmanダイバージェンスや双対平坦空間が得られることを見てきた。これらの事実より、指数型分布族にもこれらの情報幾何学的な構造を定めることができる。本章ではそれを見ていこう。

Riemann計量

Riemann計量は以下のように求められるのだった。

右辺は式(1)である程度まで計算したが、それをさらに以下のように変形してみる。

これはFisher情報行列に他ならない[5]。

例:指数分布

せっかくなので例を見てみよう。指数型分布族に属する確率分布はいろいろあるが、ここでは指数分布をピックアップしてみる。指数分布の確率密度関数は以下の式で表される[6]。

ただし、である。

の場合の式において

と置いて少し変形すると以下のようにできる。

そのため、指数分布は指数型分布族に含まれる。

双対座標と双対凸関数

双対座標は以下のようになる。

双対凸関数は以下のようになる。

Riemann計量

指数分布はパラメータが1つしかないため、Riemann計量はスカラーとなる。具体的には以下のように計算される。

Riemann計量が分かるとパラメータ空間の中での確率分布同士の距離が分かる。確率分布同士の距離とは、定性的には確率分布の形状が互いにどれくらい異なるかを表すものと考えられる。

今回の例の場合、指数分布の平均はであるため、

の絶対値が大きくなると平均は0に近づいていく。そのような領域では

の値が少し違う分布同士でほとんど形状の差がなくなる。これは

の絶対値が大きくなるに連れてRiemann計量の値が0に近づいていくことに対応する。

一方、が0に近いところでは

が僅かに変わるだけで平均値が大幅に変動し、分布の形状が大きく変わる。これは

が0に漸近するに連れてRiemann計量が急激に大きくなることと関連している。

ただし、本当は分散による影響も加味する必要がある。指数分布の分散はであるため、

が0に近いところでは分散が大きくなる。分散が大きくなると分布が散らばるため、

が変化しても分布が変動し辛くなる。これは先程の平均の議論と逆のことを言っていることになるが、指数分布の場合は平均の変化の方が分布の形状を決める上で支配的な要因になっているということなのだろう。

まとめ

本稿では指数型分布族が持つ情報幾何学的な構造について調べた。指数型分布族には必ず凸関数が付随し、これにより得られるBregmanダイバージェンスはKLダイバージェンスになっていることを見た。さらに、付随する凸関数から定められるRiemann計量はFisher情報行列に一致することが分かった。

参考

[1]

![別冊数理科学 情報幾何学の新展開 2014年 08月号 [雑誌] 別冊数理科学 情報幾何学の新展開 2014年 08月号 [雑誌]](https://images-fe.ssl-images-amazon.com/images/I/51aLAohK4BL._SL160_.jpg)

別冊数理科学 情報幾何学の新展開 2014年 08月号 [雑誌]

- 出版社/メーカー: サイエンス社

- 発売日: 2014/08/22

- メディア: 雑誌

- この商品を含むブログを見る

[3] ヘッセ行列 - Wikipedia

[4] カルバック・ライブラー情報量 - Wikipedia

[5] フィッシャー情報量 - Wikipedia

[6] 指数分布 - Wikipedia

情報幾何学を嗜む ~微分幾何学的な双対平坦空間の導入~

前回の記事ではBregmanダイバージェンスから導かれる双対空間について述べた。本稿ではこれらの空間に定められる双対接続、及びそこから導かれる双対平坦空間について考えてみる。

基本的には本[1]を参考にしているのだが、この本はどうも双対平坦な空間の導出がざっくりしすぎていて、少々納得感に欠けた。そのため、本稿では双対平坦な空間の導出に関する計算を少しだけ泥臭く書いてみることにする。

なお、本稿では全体的にEinsteinの規約を用いているので注意されたい。

ダイバージェンスから導かれるRiemann計量

前回の記事でダイバージェンスの定義について説明した。その中で、Taylor展開した際の2次の項の係数が正定値対称行列になるという条件があった。この正定値対称という条件はいかにもRiemann計量を想起させる。実際、情報幾何学ではこれをRiemann計量として使うことで、確率分布のパラメータの空間をRiemann多様体と見なすのである。

Bregmanダイバージェンスの場合の例

例として、以下の2変数凸関数から導かれるBregmanダイバージェンスについて、そこから得られるRiemann計量を計算してみよう。

始めにが凸関数であることを確認する。Hesse行列は以下のようになる。

となるため、これは凸関数である。

次に、Riemann計量を求めてみる。と言っても、前回の記事でBregmanダイバージェンスをTaylor展開した際の2次の項は、元になる凸関数のHesse行列に等しいことを述べた。そのため、結局がリーマン計量である。

よく見るとは確かに対称行列になっている。これは

が

級なので当然である。また、以下の計算により正定値行列であることも分かる。

ただし、である。

Riemann計量を成分毎に書き下すと以下のようになる。

双対接続

次に、多様体の接続について考えてみる。情報幾何学において特に重要な概念として双対接続がある。少々難しい概念なので、順を追って説明していこう。

接続とは

ざっくり言うと、接続とは多様体の異なる点における接空間の間に対応関係を与えるものである。特に、その対応関係にある種の線形性があるものをAffine接続と呼ぶ。Affine接続を説明すると長くなるので、詳細は[2]などを参照のこと。

Levi-Civita接続

Affine接続のうち、さらに以下の2つの性質を満たすものをLevi-Civita接続と呼ぶ。

(対称な接続)

(計量との整合性)

Levi-Civita接続はベクトルの平行移動に対して計量を保つため、Riemann計量と強い依存関係がある。実際、Levi-Civita接続の接続係数はRiemann計量から一意に定まる。詳細は[2]などを参照のこと。

ここで、を1つ目の式に代入してみる。ただし、局所座標系を

とし、

とする。

成分を比較してとなる。

次に、を2つ目の式に代入してみる。

最後の式の右辺でなどの置き換えをすると以下のようになる。

双対接続

Levi-Civita接続における計量との整合性の条件を外し、代わりに2つの接続が以下の条件を満たすとする。

このような接続を双対接続と呼ぶ。

Levi-Civita接続の時と同様にを代入すると以下のようになる。

・・・(1)

ただし、接続係数の右肩に*が付いているものはの接続係数であることを意味する。

Bregmanダイバージェンスから導かれるRiemann空間の双対平坦性

前回の記事で、Bregmanダイバージェンスから導かれる双対空間について述べた。以下では元の空間の座標を、双対空間の座標を

で表す。

今、双対接続として、接続

の

座標における接続係数が全て大域的に0になるようなものを考える。これはつまり、曲率が0の平坦な接続であることを意味する。この時、接続

がどうなるかを考えてみよう。

準備

いくつか式を準備しておこう。ここでは座標、

座標で表した接続係数をそれぞれ

などと表記する。また、Riemann計量についても同様に

のように表記する。

片方の接続が平坦な場合の双対接続の式

まず(1)式に接続係数0を代入すると以下の式が成立する。

・・・(2)

ここで、Riemann計量の対称性よりであり、さらに接続の対称性より

となる。これらを組み合わせると、添字の並び替えに対して

の接続係数が不変となることが分かる。特に、以下の式はのちほど利用するため明示的に述べておく。

・・・(3)

Riemann計量の別表現

元の空間に定義された凸関数を、双対空間に定義された凸関数を

とすると、

座標と

座標の変換は以下の式で表されるのだった。

これらの両辺をそれぞれで偏微分すると以下のようになる。

・・・(4)

・・・(5)

以上により、座標、

座標におけるRiemann計量を凸関数を用いずに表すことが出来た。

接続係数の座標変換

最後に、接続係数の座標変換について述べる。座標系から

座標系への接続係数の変換式は以下のようになる[2]。

この変換式は有名なので調べればすぐに出てくるが、添字を下げた版のの座標変換式に関してはほとんど情報がない。幸いEMANさんのサイト[3]がヒントになったので、それを参考に変換式を導出してみる。

まず、上で示した変換式の両辺にをかけて

について和を取る。和の記号はEinsteinの規約により省略する。

ここで、Riemann計量の座標変換式を利用する。これもEMANの物理学[4]から式を引用する。

これを代入し、さらに左辺を添え字を下げた記号に置き換えると以下のようになる。

・・・(6)

双対平坦性の導出

準備が整ったので本題に入る。少々天下り的だが、を

に変換する式を考えてみる。

1つ目の等号は式(6)から、2つ目の等号は式(5)から、3つ目の等号は偏微分の連鎖律から、5つ目の等号は式(2)(4)から、6つ目の等号は式(3)からそれぞれ得られる。

右辺第2項と左辺が一致するため、任意の点において右辺第1項は0でなければならない。右辺第1項に式(4)を適用すると以下のようになる。

今考えている状況においてRiemann計量はgivenであるため、右辺第1項が0になるためにはになる他ない。つまり、双対座標系において接続

は平坦となるのである。

以上の議論をまとめてみる。多様体上にBregmanダイバージェンスから定まるRiemann計量が与えられ、更に双対接続が与えられたとする。接続

が

座標系で平坦となるとき、接続

は

座標系において平坦となる。このような接続の組が与えられた空間を双対平坦空間と呼ぶ。

蛇足

双対平坦空間の説明として、本稿のように接続係数の座標変換から直接的に平坦性を示す方法を採っている記事が全く見つからなかったため、本稿の計算は完全に私が考えたものである。先人がいないということもあり、正直あまり自信がない。本[1]から結論だけは分かっていたため、やや結論ありきで論理展開してしまっているような気がする。もし不備にお気づきの際はご指摘頂けるとありがたい。

まとめ

本稿ではBregmanダイバージェンスからRiemann計量が得られ、さらにそこから双対平坦な空間が導かれることを述べた。双対平坦性の導出には少々複雑な計算を行ったが、おかげでこれまでのもやもやが少しだけ晴れたような気がする。

情報幾何学関連の記事はまだまだ書きたい事が多いが、なんとか今年中には書き終えたい。

参考

[1]

![別冊数理科学 情報幾何学の新展開 2014年 08月号 [雑誌] 別冊数理科学 情報幾何学の新展開 2014年 08月号 [雑誌]](https://images-fe.ssl-images-amazon.com/images/I/51aLAohK4BL._SL160_.jpg)

別冊数理科学 情報幾何学の新展開 2014年 08月号 [雑誌]

- 出版社/メーカー: サイエンス社

- 発売日: 2014/08/22

- メディア: 雑誌

- この商品を含むブログを見る

[3] EMANの物理学・相対性理論・共変微分

[4] EMANの物理学・相対性理論・計量とは何か

情報幾何学を嗜む ~Bregmanダイバージェンスとその双対~

最近、情報幾何学の勉強をしている。情報幾何学は日本の甘利先生という方が切り開いてきた分野で、主には確率分布のパラメータが成す空間をリーマン多様体と捉えることで、確率分布族に対して幾何学的な解釈を与えるものである。

情報幾何学は情報科学の一分野でありながら、微分幾何学の理解を要する難解なものである。はっきり言って、情報系の人間で可微分多様体やらリーマン計量やら接続やらを理解している人は一握りであろう。私も情報系、それも工学部の出身であるから、甘利先生の本を初めて手に取った修士2年のときは、あまりの難しさに一瞬で心が折れたのを覚えている。

しかし時は流れ、私も今ではわずかばかり数学の心が分かるようになってきた。そこで、いよいよこの難攻不落の要塞に攻めいってみようというわけである。

というわけで、本稿から始まるいくつかの記事の中で、情報幾何学における主要なトピックについて私が理解したところを書き連ねてみようと思う。本稿ではその第一歩として、Bregmanダイバージェンスとその双対ダイバージェンスについて考えてみる。

ダイバージェンス

情報幾何学を語る上でダイバージェンスの存在は外せない。ダイバージェンスの定義を[1]から引用する*1*2。

ただし、は有限次元ベクトルである。

ダイバージェンスは距離の公理を満たしていない。すなわち、一般にはとならない。この醜い非対称性が後に華麗な蝶へと変貌を遂げるのであるが、それは双対ダイバージェンスのところで説明する。

Bregmanダイバージェンス

ダイバージェンスの中でも特に重要なものの1つにBregmanダイバージェンスがある。これは滑らかな狭義凸関数*3を用いて以下のように定義される[1]。

まず、点における接超平面の方程式は以下のようになる。

点において、この接超平面と元の関数

の差は以下のようになる。

これを凸関数から導かれる

から

へのBregmanダイバージェンスと呼ぶ。

Bregmanダイバージェンスがダイバージェンスの定義を満たすことは自明ではないため、本来であれば証明すべきである。実際、ノートで計算して確かめることは出来たのだが、それをブログに書き起こす気力と時間がなくなってしまったため、ここでは割愛する。

参考までに計算の指針だけ述べておく。まず、について

における多変数のTaylor展開を計算する。0次の項は

である。1次の項も計算すると0になる。2次の項は計算すると

のHesse行列に等しくなる。

は滑らかな凸関数と仮定しているため、これは正定値対称となる。

Legendre変換による双対空間

Bregmanダイバージェンスを定義するために凸関数が登場した。凸関数といえば皆さん何を思い浮かべるだろうか?いろいろあると思うが、凸関数にまつわる重要な概念としてLegendre変換が挙げられる。Legendre変換を行うことで、凸関数が定義された空間の双対空間、及び双対凸関数を得ることができる。

最終的には多変数の場合を考える必要があるが、まずは1変数の場合から考えてみよう。

1変数凸関数のLegendre変換

1変数の滑らかな凸関数を考える。滑らかな凸関数の導関数は異なる

に対して必ず異なる値を取る。逆に適当な実数

を与えると、それを導関数の値とするような点

が一意に決まる。

すなわち、の定義域を

、値域を

とすると、

は全単射となる。

のことを双対空間と呼ぶ。

ここで、に以下のような変換を施すことで双対空間に対して新たな関数

を定める事ができる。

これをLegendre変換と呼ぶ。

右辺のを最大にする

について考えてみよう。最大値を与える

においては、この式を

で微分したものが0となる必要がある。すなわち、以下が成立する。

すなわち、の値が

となるような

において

は最大となる。これはつまり、

の元と一対一に対応する

の元を選べば良いということを意味する。

詳細は後述するが、実はも凸関数であり、これを双対凸関数と呼ぶ。そのため、

に対して再度Legendre変換を施すことができるが、その結果は元の関数

と一致する[2]。つまり、Legendre変換の逆変換はLegendre変換そのものである。これより、双対性というのはあくまで相対的な概念に過ぎないことが分かる。

多変数凸関数のLegendre変換

少々くどいかもしれないが、1変数のときと同じ議論を多変数についても行ってみよう。

2つ以上の変数を持つ滑らかな凸関数を考える。滑らかな凸関数の勾配ベクトルは異なる

に対して必ず異なるベクトルとなる。逆に適当な実数値ベクトル

を与えると、それを勾配ベクトルとするような点

が一意に決まる。

この対応関係により、定義域との勾配ベクトルが取り得る値の間に一対一の対応関係が得られる。

が成す空間のことを双対空間と呼ぶ。

すなわち、の定義域を

、値域を

とすると、

は全単射となる。

のことを双対空間と呼ぶ。

ここで、に以下のような変換を施すことで双対空間に対して新たな関数

を定める事ができる。

これをLegendre変換と呼ぶ。

右辺のを最大にする

について考えてみよう。最大値を与える

においては、勾配ベクトルが零ベクトルとなる必要がある。すなわち、以下が成立する。

すなわち、の値が

となるような

において

は最大となる。これはつまり、

の元と一対一に対応する

の元を選べば良いということを意味する。

証明は大変そうなので諦めるが、1変数の場合と同じくも凸関数であり、これを双対凸関数と呼ぶ。そのため、

に対して再度Legendre変換を施すことができるが、その結果が元の関数

と一致するというのも1変数の場合と同様である。

双対ダイバージェンス

双対凸関数は凸関数なので、これを用いると双対空間にもBregmanダイバージェンスを定義できる。

これを双対ダイバージェンスと呼ぶ。

元のダイバージェンスとの関係

双対ダイバージェンスと元のダイバージェンスとの間には重要な関係がある。以下でそれを導いてみよう。

について、双対空間において対応する点がそれぞれ

であるとする。このとき以下の式が成り立つ。

これらを双対ダイバージェンスの式に代入すると以下のようになる。

これにを代入すると以下のようになる。

結局、以下の式が得られた。

ダイバージェンスの定義を説明した際、ダイバージェンスは対称性を満たさないということを述べた。しかし、上式が示す通りBregmanダイバージェンスについては2つの引数を入れ替えたものは双対ダイバージェンスに一致するのである。元の空間だけでは対称性がないように見えるが、双対空間まで広げて考えるとこのように美しい対称性が現れるというのは非常に面白い。

ナブラを使わない表現方法

Bregmanダイバージェンスの定義式にはナブラ () が含まれており少々複雑である。実はこれはちょっとした式変形で回避できる。

これまでの議論が追えていれば簡単なので、以下に式変形だけ示す。

まとめ

本稿では情報幾何学のトピックのうち、Bregmanダイバージェンスとその双対ダイバージェンスに関する事柄について述べた。ダイバージェンスは対称性を持たないが、BregmanダイバージェンスについてはLegendre変換による双対空間まで考えることで美しい対称構造が得られることを確認した。

本稿ではまだ微分幾何学らしい概念は登場しなかった。つまり、ここで述べたことは情報幾何学の中ではまだまだ序の口ということである。次回以降、少しずつ幾何学的な内容に踏み込んでいきたいと思う。

参考

[1]

![別冊数理科学 情報幾何学の新展開 2014年 08月号 [雑誌] 別冊数理科学 情報幾何学の新展開 2014年 08月号 [雑誌]](https://images-fe.ssl-images-amazon.com/images/I/51aLAohK4BL._SL160_.jpg)

別冊数理科学 情報幾何学の新展開 2014年 08月号 [雑誌]

- 出版社/メーカー: サイエンス社

- 発売日: 2014/08/22

- メディア: 雑誌

- この商品を含むブログを見る

*1:甘利先生の本[1]ではダイバージェンスの微分可能性などに触れられないままいきなりTaylor展開しているところがもやもやする。あまり細かい数学的議論に重きを置いた本ではないので、これについては滑らかな関数であり、かつ剰余項は収束すると仮定を置いてしまうしかないのだろう。

*2:ダイバージェンスの引数に点を入れたり点の座標を入れたりと記号がぶれているが、本[1]に合わせた結果なので好意的に解釈して頂けるとありがたい。

*3:本[1]ではBregmanダイバージェンスの定義に用いる凸関数の性質について厳密な条件が記載されていない。議論を簡単にするために、ここでは滑らかな狭義凸関数であるとした。

クーポンコレクター問題の確率分布を解き明かす

クーポンコレクター問題というものをご存知だろうか?これは、例えば6種類のおもちゃが出るガシャポン*1があったとして、何回くらい引けば全種類引き当てる事ができるか?というようなことを考える問題である。

この問題に対して、平均や分散がどうなるかということは非常によく語られることである[1]。また、時として不等式による評価について議論している記事を見かけることもある[2]。

しかし、肝心の確率分布については議論される事が非常に少ない。あまりにも記事を見かけないので、私は当初クーポンコレクター問題の確率分布を求めることは不可能なのではないかとさえ思っていた。

それでもめげずに調べ続けた結果、私はついに確率分布について結論を出しているページを見つけた。本稿ではそれを紹介し、喜びを分かち合いたいと思う。

第2種スターリング数

クーポンコレクター問題の確率分布を求めるためには、第2種スターリング数について理解しておく必要がある。少し長いが、定義をWikipediaから引用する[3]。

定義も大切なのだが、第2種スターリング数は以下のように特徴付けられるということが重要である[3]。

クーポンコレクター問題の確率分布

準備が整ったので、確率分布を求めてみよう。以下の議論は全て[4][5]を参考にした。

集めるクーポンの種類を種類とし、初めて全種類のクーポンを取得できるまでの試行回数を表す確率変数を

とする。この時、

回目の試行で初めて全種類のクーポンを取得できる確率

を求める。

回の試行により出現し得るクーポンの出方の総数は

である。もし

回目の試行で初めて全種類のクーポンが出るパターンの総数が分かれば、それを

で割ったものが求める確率である。

回目の試行で初めて全種類のクーポンが出揃うということは、

回目の時点で

種類のクーポンがすでに出ている必要がある。このパターンの総数を求めるために、

回目までの試行に対して1から順に番号を割り振る。そして、これらの番号付けられた試行を

個のグループに分ける。同じグループに分けられた試行については同じクーポンが得られたと考える。この分け方のパターンの総数は第2種スターリング数

となる。

第2種スターリング数は分けられたグループの間の順序は区別しないが、今はクーポンの種類は区別されるので、を掛ける。さらに、

回目までに出る

種類のクーポンは

種類のうちどれであるかは問わないので、全てのパターンをカウントする必要がある。そのため、

を掛ける。結局、

回目の時点で

種類のクーポンが出現するパターンの総数は

となる。

回目の試行でまだ出ていない最後のクーポンが出るパターンの総数は1なので、

回目の試行で初めて全種類のクーポンが出るパターンの総数は

となる。以上の議論により次の式を得る。

計算してみよう

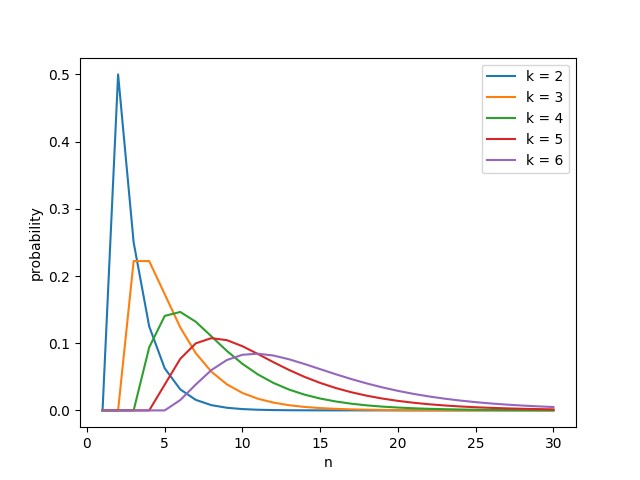

にいくつか具体的な数値を入れて

を計算してみよう。手計算ではやっていられないので、pythonを利用する。第2種スターリング数はsympyのstirling関数を用いて計算することが出来るので、それを利用する[6]。数値だけ示しても分かり辛いので、結果をmatplotlibでグラフ化した。Python自体はpydroid3を使って実行した[7]。なお、sympyなどの必要なパッケージはあらかじめpipでインストールしておく必要がある。

計算に用いたソースコードを以下に示す。

from sympy.functions.combinatorial.numbers import stirling import matplotlib.pyplot as plt import math startCouponKind = 2 numCouponKind = 6 numTrial = 30 for k in range(startCouponKind, numCouponKind+1): x = [] y = [] for n in range(1, numTrial+1): stir = stirling(n-1, k-1, kind = 2) prob = math.factorial(k) * stir / (k**n) x.append(n) y.append(prob) plt.plot(x, y, label='k = {}'.format(k)) plt.legend() plt.savefig('/storage/emulated/0/coupon.png')

得られたグラフを以下に示す。

途中でピークを持ち、右側に裾野が広がっている様子が見て取れる。が小さいときに確率が0となる領域があるが、これはクーポンの種類よりも試行回数が少ないときの様子が表れているものである。

また、の増え方に対して、ピークの位置が右に移動していく速度の方がやや速いように見える。実際、全種類コンプリートするまでの試行回数の期待値は

なので、これは理論的にも辻褄が合っている[1]。

まとめ

本稿ではクーポンコレクター問題の確率分布を明らかにし、実際に計算を行った結果を示した。クーポンコレクター問題ではパターンを数え上げる事が難しかったが、その難しさを既知の概念である第2種スターリング数に押し込めることで、理論的にスッキリとした結論を得ることができた。

これまで組み合わせ数学には興味がなかったが、本稿を書き上げるうちにその面白さを垣間見る事ができた。またいずれ体系的に勉強しよう。

参考

[1] クーポンコレクター問題 - Wikipedia

[2] コンプガチャの数理 -コンプに必要な期待回数の計算方法について- - doryokujin's blog

[3] スターリング数 - Wikipedia

[4] combinatorics - Probability distribution in the coupon collector's problem - Mathematics Stack Exchange

[5] CDF of probability distribution with replacement - Mathematics Stack Exchange

[6] Combinatorial — SymPy 1.3 documentation

[7] https://play.google.com/store/apps/details%3Fid%3Dru.iiec.pydroid3%26hl%3Dja%26referrer%3Dutm_source%253Dgoogle%2526utm_medium%253Dorganic%2526utm_term%253Dpydroid3%26pcampaignid%3DAPPU_1_5SOHXJe-E4-Pr7wPpLSfwAE

*1:これの呼び方は地方によって差があるような気がするが、自分の流儀で呼ばせて頂く。

いくつかのLie群がLie群であることを定義に戻って確かめる

Lie 群は難しい。この理由の1つは、議論の前提となる領域が広いことにあると思われる。Lie群とは群であり多様体であるような数学的対象である。そのため、定義を理解するだけで群論と多様体の知識が求められる。また、Lie群の教科書で最初に扱われるような基本的なLie群は行列群である。しかも、そのコンパクト性に着目した議論も多い。そのため、線形代数と位相空間の基礎的な事項も理解しておくことが望ましい。

繰り返すが、Lie群は難しい。私はここ最近Lie群を勉強し始めて、この事実を痛感している。こういう時は足元を一歩ずつ踏み固めて行くしかない。その一環として、本稿ではいくつかの基本的なLie群について、それらが本当にLie群になっていることを定義に照らし合わせて確認してみる。

本稿では私の独断で以下の2つのLie群を扱う。

- 一般線形群

- 直交群

準備

多様体上の写像が 級であるということ

級であるということ

Lie群の定義の中で級写像という言葉が出てきた。この定義を[2]より引用する。

(1)

(2)

この2つの条件がなりたつことである. ただし,

上記定義においてとすれば

級写像の定義となる。

Lie群であることの確認

以上で準備が整ったので、Lie群であることの確認に移る。本稿では群であることの確認はサボり、それぞれのLie群について以下の3点を確認した。

一般線形群

級多様体であること

級多様体であること

上

次正方行列全体の集合を

と書く。

は

の部分集合のうち、以下のように表されるものである。

実は、は

の開部分集合となる。詳細は[3]の命題1.17に譲り、ここでは概要だけ説明する。まず、

は連続写像である。このとき、

と書ける。

は

の開集合なので、連続写像

による逆像も開集合となる。

ここで、に属する行列の各成分を座標と見なすと、これは

と同一視できる。そのため、

は

級多様体となる。その開部分集合も

級多様体となるので、

は

級多様体となる。このような多様体を開部分多様体と呼ぶ[2]。

直交群

級多様体であること

級多様体であること

これを示すのは思いのほか難しいため、証明のアウトラインだけ述べることにする。詳細は[4]を参照されたい。

次実対称行列全体の集合を

とする。

は

と同一視できるため、

次

級多様体である。

この時、以下のような写像を考える。

は

級写像である。

が直交行列のとき、その逆行列は

となる。そのため、

となる。ここで、

は単位行列である。

もしが

の正則値であれば、先ほど提示した定理により

は

次

級多様体となる。そのためには、

の全ての点における微分が全射になれば良い。具体的に微分計算を行い、それが全射であることを確かめるアプローチになるが、体力の限界なのでこれ以降は[4]にお任せする。

参考

[1] http://www.math.tsukuba.ac.jp/~tasaki/lecture/ln2010/2010t.pdf

[2]

- 作者: 松本幸夫

- 出版社/メーカー: 東京大学出版会

- 発売日: 1988/09/22

- メディア: 単行本

- 購入: 7人 クリック: 36回

- この商品を含むブログ (33件) を見る

[4] http://math.uchicago.edu/~may/REU2014/REUPapers/Rouse.pdf